像医生一样看病:WiseDiag V2开启医疗AI的分水岭

去年今日,智诊科技发布WiseDiag V1时,业界还在为AI能读懂病历、回答医学问题而喝彩。一年后,当鹿仲豪和他的算法团队再次站在发布台上,他们带来的不再是一个只会咬文嚼字的文本助手,而是一个真正拥有了视觉皮层的全能医疗大脑。

中医讲望闻问切,望诊居于首位。千年来,医生看病从不是只读文字,而是要亲眼看见患者的面色、舌苔,细观影像片子上的阴影变化。这种天然的多模态属性,恰恰成了上一代医疗AI无法逾越的鸿沟。WiseDiag V2的诞生,正是为了填平这道鸿沟——它让AI第一次能够像医学生跟师临诊那样,用眼睛捕捉病灶,用大脑调动知识,完成从看见到看懂的认知跃迁。

这并非简单的看图说话功能叠加。算法工程师道出了背后的苦功:团队联合50余位三甲医院专家,对3万多例包含影像、皮肤照片的真实病历进行了深度拆解。他们标注的不只是“这是什么病”,更是“为什么是这个病”的推理路径。这种将专家思维对齐进模型的做法,让WiseDiag V2在面对一张面部红斑照片时,不再像某些通用模型那样摇摆不定——今天说是过敏,明天猜是玫瑰痤疮。它一眼锁定了蝶形红斑这个关键体征,直指系统性红斑狼疮的核心诊断,并给出鉴别思路和追问建议。

如果说单图识别考验的是眼力,那么面对一堆零散信息还能拎出真相,考验的则是真正的临床穿透力。发布会现场展示了一个刚满月婴儿的病例:一张胸部X光片、一张足部外观照、一张血常规化验单。普通的模型要么看不见,要么各说各话——看脚的说是骨折,看血的说是肺炎。这种割裂好比盲人摸象。而WiseDiag V2的处理方式,却让人看到了一个医生应有的思考轨迹:它在X光片上锁定了食管闭锁和半椎体异常,在足部照片中识别出马蹄内翻,再结合化验单和影像读出吸入性肺炎的风险——最后将所有碎片拼成完整的诊断:VACTERL联合征。这是一种症状分散、极易被当成几个不相干毛病的先天疾病,而模型恰恰展现了捕捉碎片信息并综合分析的能力。

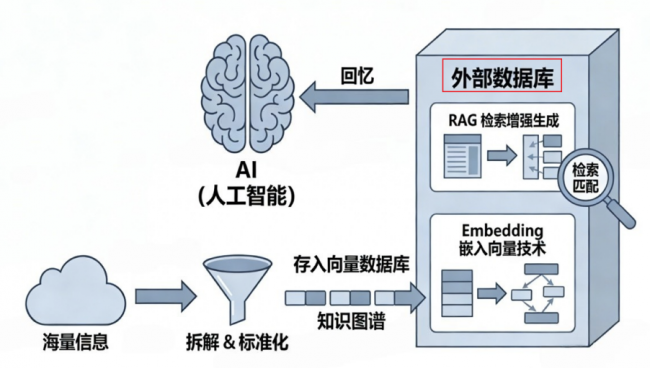

这种能力的背后,是实打实的技术底座升级。从V1到V2,医疗语料从450亿Token增长到800亿,覆盖更完整的疾病谱系;模型架构从稠密走向混合专家,在保持千亿参数能力上限的同时兼顾了落地成本;128K的长上下文让它可以一次读完5年病史,做时间轴式的整合分析。更重要的是,它实现了图文同构——看到的像素级病灶,直接对应着大脑里的医学知识,而不是先把图片转成文字再处理。

成绩单印证了实力的跃升。在覆盖问诊、诊疗、安全与伦理等多维度的MedBench榜单上,WiseDiag V2以69.8分位居榜首;在对标人类执业医师水平的MedQA测试中,它拿到93.6的高分;在多模态医学影像评测集vl-health上也达到69.2分。而且,OpenAI在2025年5月发布的医疗评测集HealthBench——这个由梅奥诊所、克利夫兰医学中心等顶尖机构的262位医生参与构建的测试集,真实模拟临床场景,难度极高。多数知名模型仅拿到53分,而WiseDiag V2跑出了67.2分的全球领先成绩。

但分数终究是给专家看的,体验才是给用户用的。在发布会上有一句话颇为精到:“医疗AI卷参数、卷算力,那只是入场券;真正决定天花板的,是它对医学世界的‘理解深度’。”从只会读文字到能同时看懂报告、影像、皮肤照片,WiseDiag V2完成的不是单项能力的叠加,而是认知维度的升维。它用海量数据构建知识底座,用视觉能力捕捉病灶细节,最后通过专家思维的对齐,把所见与所知融为一体。

这让人想起那个68岁糖尿病女性的案例:主诉消化不良、上腹发闷、牙床酸痛、肩膀沉重。普通模型当成胃炎建议胃镜,而WiseDiag V2却从非典型症状组合中嗅出了心梗的风险,给出暂缓胃镜、优先心内科的安全建议。这种危急重症识别+行为建议的能力,正是临床最需要的价值。

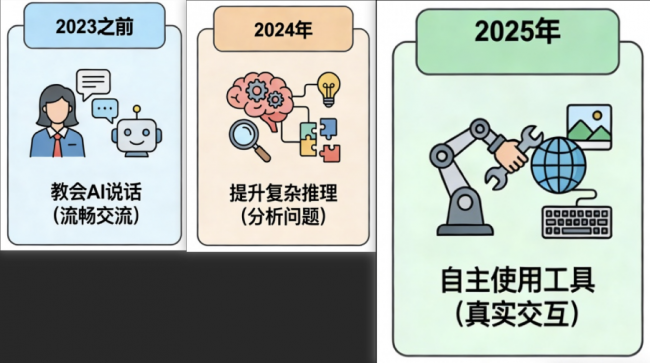

今天的AI,已经能够像医生一样把碎片化的信息拼成一个完整的人。而明天,智诊科技将发布医疗端到端智能体,让AI不仅能想,还能做。从记忆到视觉,从思考到行动,这条技术进化的路径,正在重新定义医疗AI的边界。

本站部分内容来源于网络,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责,本网站无法鉴别所上传图片或文字的知识版权,如果侵犯,请及时通知我们,本网站将在第一时间及时删除,不承担任何侵权责任。